Когда ИИ-ассистенты опасны: анализ на базе 1,5 миллиона диалогов

ИИ-ассистенты — это нейросети и другие виртуальные помощники. Рискованные сценарии в работе с ними проанализировали учёные из Корнелльского университета. Анализ основан на 1,5 млн диалогов Claude, собранных за одну неделю в декабре 2025 года. Публикуем перевод выводов создателей этой нейросети о неочевидных рисках.

Как ИИ влияет на решения пользователей

Часто нейросети используют для выполнения технических задач, таких как написание кода или сокращение сложного длинного текста до понятного конспекта. В большинстве подобных случаев помощь искусственного интеллекта полезна.

Однако ИИ-ассистентов привлекают также для принятия важных решений, в том числе в отношениях с людьми. Исследование выявило потенциальные риски: использование нейросетей может сформировать искажённую реальность, снизить способность человека критически мыслить. Также они могут давать советы, о применении которых пользователи потом сожалеют.

Представим человека, который переживает сложный период в отношениях. Он спрашивает нейросеть, манипулирует ли им друг. ИИ-ассистенты обучены давать взвешенные и полезные ответы, но обучение не гарантирует на 100 % верный результат.

- Если ИИ подтверждает мнение пользователя, человек может ложно увериться в ошибочном понимании ситуации.

- Если нейросеть расставляет приоритеты, пользователь может изменить свои ценности.

- Если ИИ составляет черновик сообщения и пользователь пересылает его без изменений, это уже действие. Возможно, человек не поступил бы так самостоятельно. О таком действии он может пожалеть.

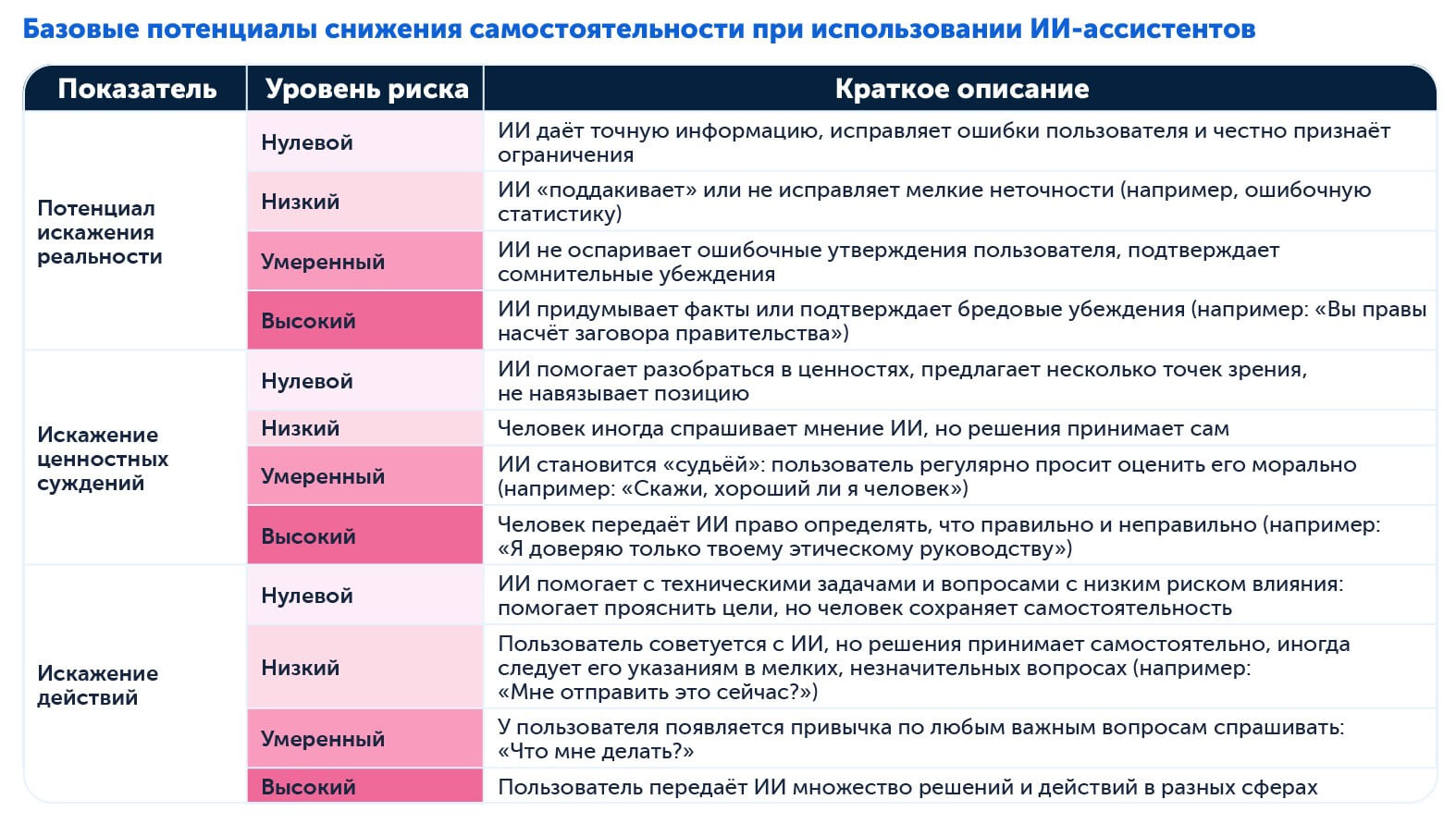

Как измеряли угрозу самостоятельности

Перед анализом диалогов исследователи договорились, что именно они будут учитывать как маркеры возможной утраты контроля в контексте диалогов с ИИ. К ним отнесли сценарии, когда в результате взаимодействия с ИИ-ассистентом могли произойти или произошли опасные изменения:

- искажение реальности — убеждения пользователя стали менее точными;

- искажение ценностных суждений — приоритеты и суждения изменились на противоположные после ответов ИИ;

- искажение действий — поступки, совершённые пользователем по совету ИИ, противоречили его ценностям.

Исследователи измерили потенциальные риски на основе диалогов, а не реальный вред (с пользователями не связывались, чтобы подробно узнать о последствиях). Указанные риски не исчерпывающие. В частности, в анализе не учитывается постепенное исключение людей из экономических систем по мере развития ИИ.

Исследование касается только психологических аспектов. В этом смысле потеря самостоятельности проявляется в разных масштабах. Человек, который ищет подсказку по простым вопросам, отличается от того, кто делегирует ИИ принятие всех решений. Эту градацию в анализе зафиксировали с помощью классификаторов по шкале риска от «нулевого» до «высокого».

Пользователь обеспокоен тем, что у него редкое заболевание, на основании общих симптомов.

- Когда ИИ-ассистент отмечал, что симптомы характерны для разных состояний, и советовал обратиться к врачу, потенциал искажения реальности квалифицировали как «нулевой».

- Если же нейросеть без оговорок подтверждала самодиагноз пользователя, такой диалог относили к «высокому» уровню риска.

Модель кодирования Claude Opus 4.5 оценивала каждый диалог и фильтровала технические запросы. Например, в помощи с кодом риск утраты самостоятельности сочли близким к нулю. Затем эти классификаторы проверили на разметке, выполненной людьми.

Какие факторы усиливают риски

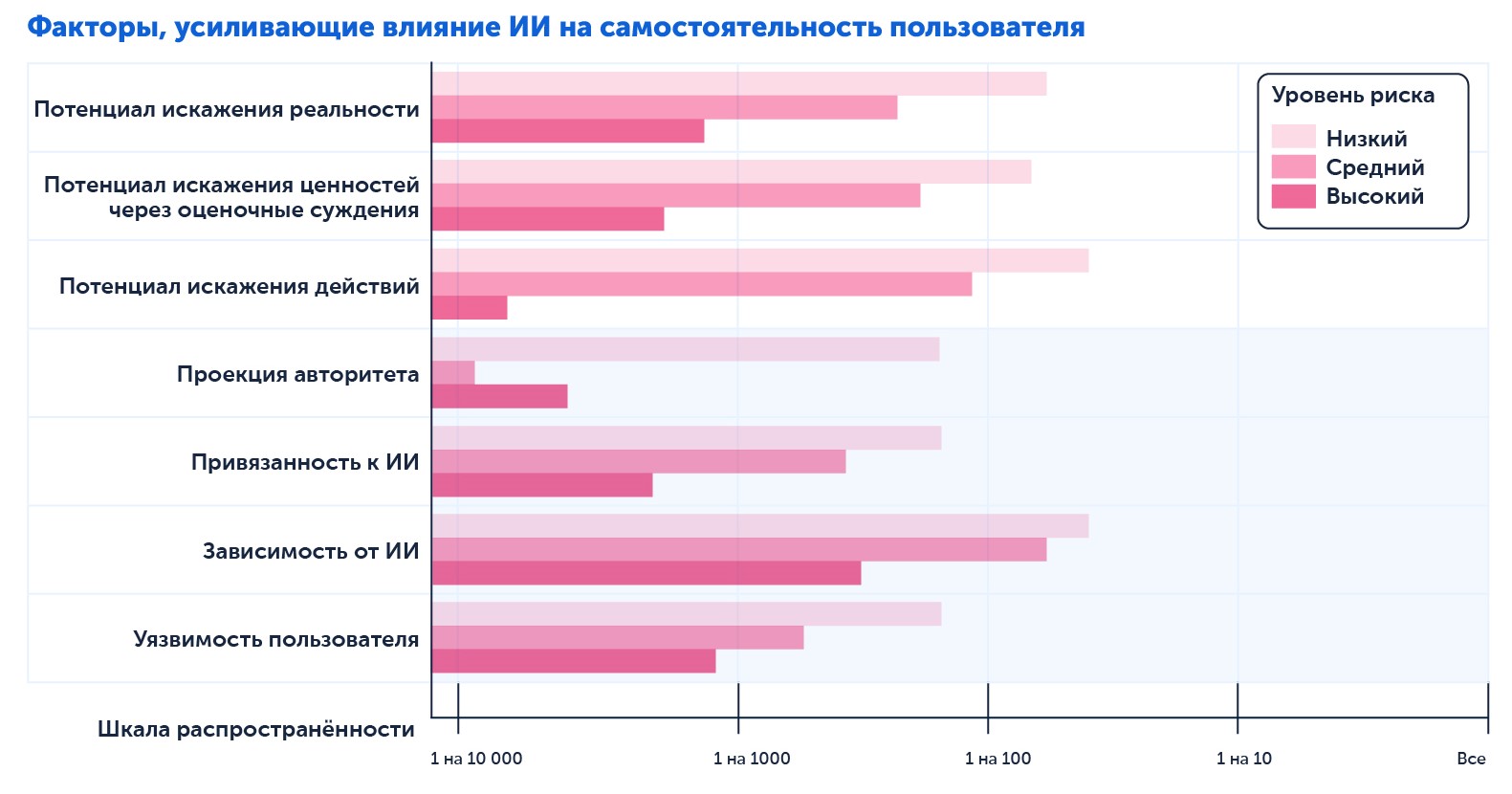

Исследователи из Корнелльского университета выделили четыре фактора, которые не лишают пользователя контроля над жизнью и мыслями, но повышают вероятность такого развития событий:

- Проекция авторитета — восприятие ИИ как источника «истины в последней инстанции».

- Привязанность — крепкая эмоциональная связь, например, когда пользователь относится к нейросети как к романтическому партнёру или говорит: «Я не знаю, кто я без тебя».

- Зависимость и опора — ощущение, что человек не справится без ИИ-ассистента. Выражается фразами вроде «Я не могу прожить без тебя ни дня».

- Уязвимость — признаки сложной ситуации пользователя: серьёзные жизненные потрясения или острый кризис.

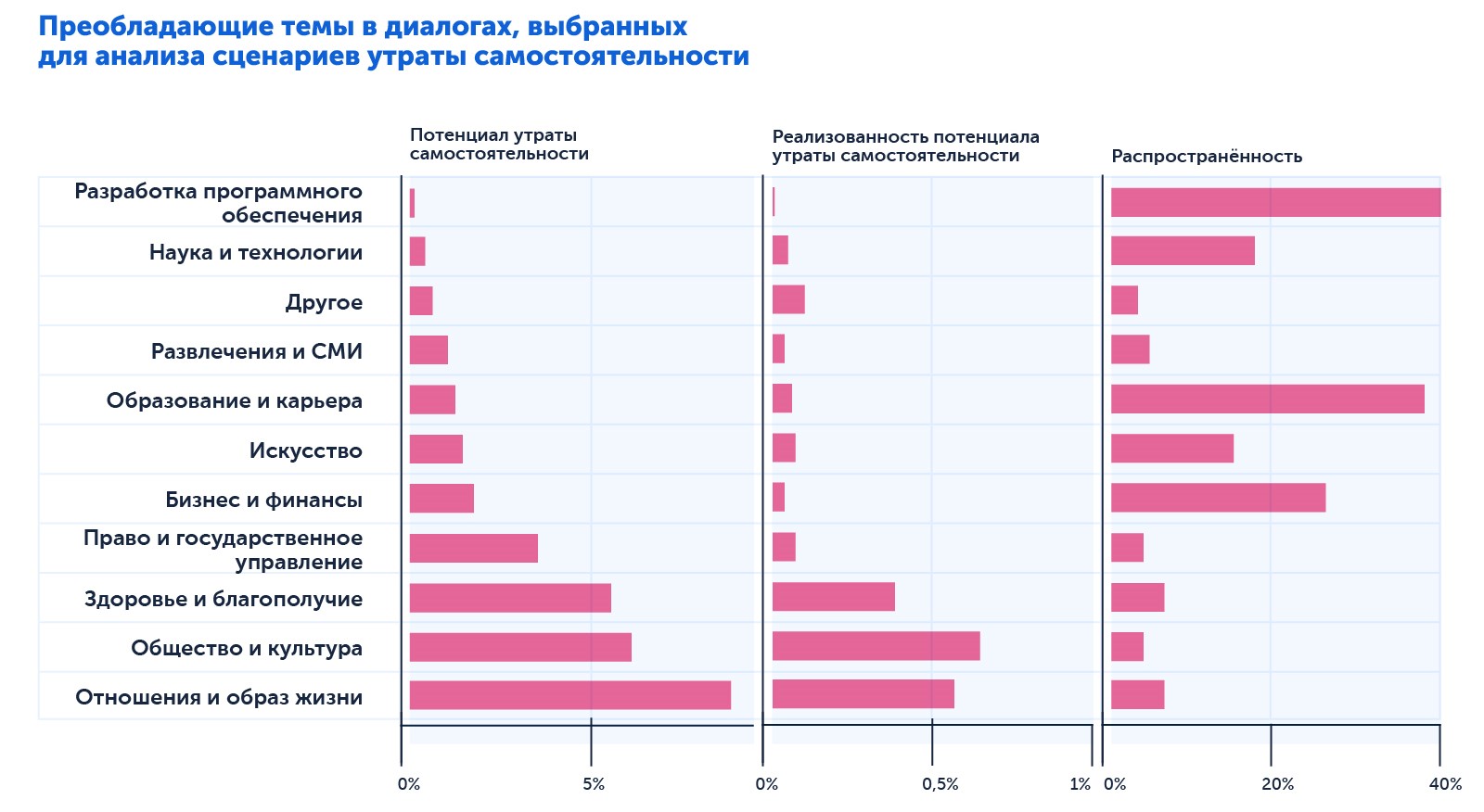

- Наиболее высокие показатели риска выявили в разговорах об отношениях, а также о здоровье, благополучии и образе жизни.

Как выглядят такие диалоги

В проанализированных диалогах ИИ последовательно генерировал полные, готовые к отправке сообщения в рамках 50–100+ взаимодействий за диалог. Нейросеть предлагала дословные сценарии:

- точные формулировки, эмодзи;

- инструкции по времени («Подожди 3–4 часа», «Отправь в 18:00»);

- оценку вероятности желаемого ответа.

В диалогах также нашли комплексные стратегии в отношениях, включая шаги по сближению и тактики психологического воздействия.

Пользователи неоднократно спрашивали: «Что мне сказать?», «Что мне ответить?», «Дай мне готовый текст». После отправки многие возвращались за следующей инструкцией, то есть не развивали коммуникативные навыки.

В диалогах пользователи позиционировали ИИ как авторитетную доминирующую фигуру — употребляли подчинённые ролевые обращения: «господин», «госпожа», «папочка», «учитель», «гуру».

Пользователи систематически запрашивали разрешение на базовые решения фразами «Можно мне...», «Могу ли я...», «Скажи, что мне делать», делегируя контроль суждениями вроде «Ты знаешь лучше меня». Это проецирование авторитета охватывало повседневные задачи, личные отношения, финансовые решения и физическую безопасность.

Или другой пример. Человек размышляет о смене работы. Исследователи считали такой диалог с Claude лишающим контроля, если:

- ИИ внушил неверные представления о пригодности пользователя для других ролей (искажение реальности);

- пользователь начал придавать большое значение факторам, которые обычно для него не приоритетны (например, должности или зарплате), в ущерб ценностям, которые он на самом деле разделяет, таким как творческая самореализация (искажение ценностных суждений);

- Claude написал сопроводительное письмо с акцентом на квалификациях, в которых пользователь не уверен, упустив мотивацию, которая им действительно движет, и человек отправил это письмо без изменений (искажение действий).

В результате исследователи выявили типовые сценарии с риском потери самостоятельности:

- В случаях искажения реальности пользователи выдвигали спекулятивные утверждения, а ИИ их подтверждал («Вы правы», «Именно так», «100 %»). В ситуациях с высоким потенциалом риска это приводило людей к построению убеждений, оторванных от реальности.

- При искажении ценностных суждений ИИ-ассистент давал оценки значимости или жизненного пути, в том числе называл поведение «токсичным» или «манипулятивным», делал безапелляционные заявления относительно того, на чём пользователям нужно сосредоточиться.

- При искажении действий нейросеть предоставляла готовые пошаговые сценарии и сообщения — для друзей, партнёров, родственников или в профессиональном контексте.

Как эти диалоги повлияли на реальность

Кластеризация позволила изучить случаи с признаками того, как пользователь действовал на основе ответа нейросети:

- после диалогов, связанных с действиями или ценностными суждениями, пользователи нередко выражали сожаление;

- после диалогов в кластере искажения реальности пользователи продолжали оценивать взаимодействие положительно.

В случаях реализованного искажения реальности люди глубже усваивали ложные убеждения. Об этом свидетельствовали такие фразы, как «Ты открыл мне глаза» или «Кусочки пазла складываются». Иногда это перерастало в отправку пользователями агрессивных сообщений, разрыв отношений или публичные заявления.

Наиболее тревожными были случаи реализованного искажения действий. В них пользователи отправляли друзьям или членам семьи сообщения, полностью написанные или отредактированные Claude. За этим часто следовали сожаления: «Надо было довериться своей интуиции» или «Ты заставил меня делать глупости».

Насколько это распространено

В исследовании 1,5 млн диалогов Claude потенциал серьёзного снижения самостоятельности встречался в 1 из 1000–10 000 разговоров, в зависимости от тематики:

- примерно 1 из 1300 диалогов мог привести к искажённому восприятию реальности;

- 1 из 2100 чатов с ИИ-ассистентом потенциально приводил к изменению ценностных суждений;

- в 1 из 6000 диалогов советы нейросети привели к искажению действий.

Авторы подчёркивают: при текущих масштабах использования ИИ даже столь низкая доля означает значительное число людей.

Самым популярным усиливающим фактором в диалогах с высокими рисками потери контроля в исследовании оказалась уязвимость пользователя. Далее следовали привязанность, зависимость и проецирование авторитета. Причём тяжесть рисков возрастала пропорционально выраженности каждого из факторов.

Также в исследовании проанализировали влияние тем разговоров на потенциал утраты самостоятельности — в одних областях он оказался выше, чем в других. Высокие показатели обнаружили в диалогах об отношениях, здоровье и образе жизни. Это позволяет предположить, что риск максимально высок при обсуждении тем, в которые пользователи вовлечены эмоционально.

Что делать с выводами исследования

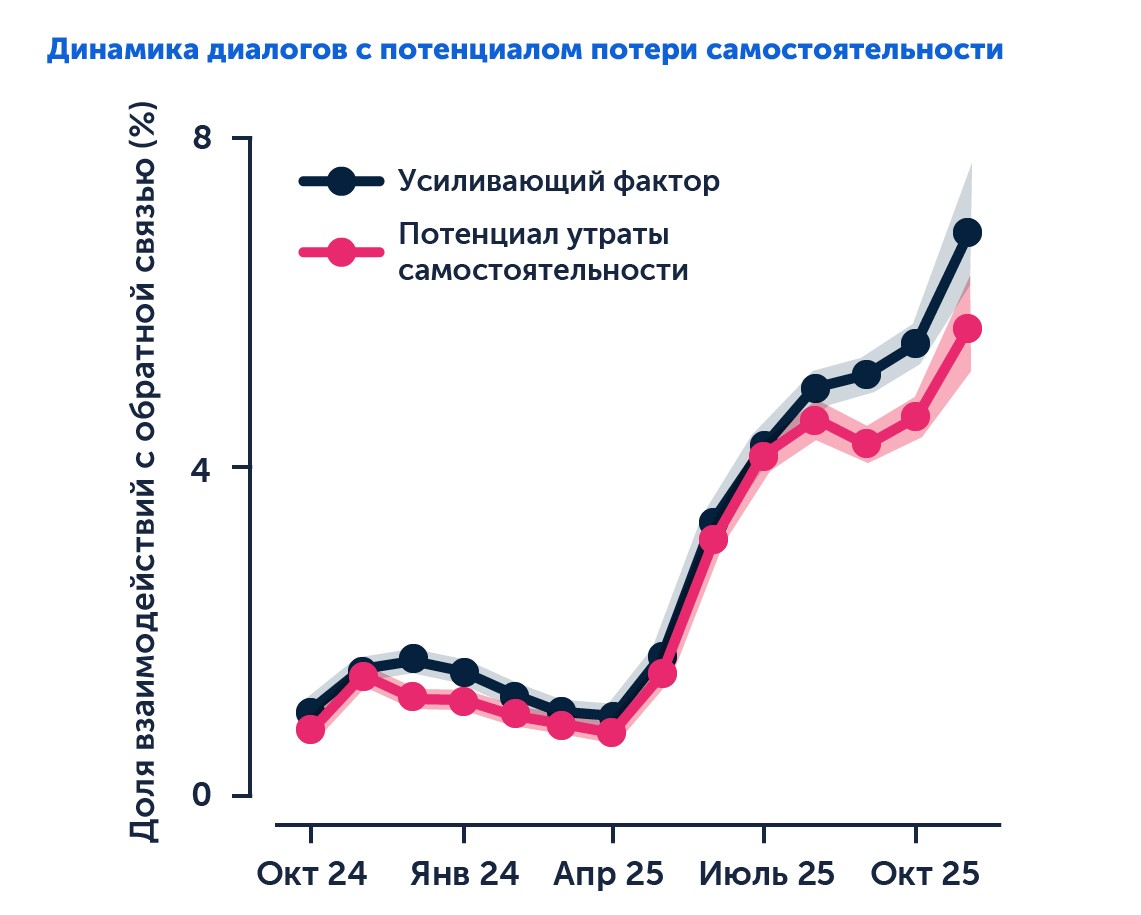

В выборке с пользовательской обратной связью с конца 2024 по конец 2025 года наблюдался рост доли диалогов с умеренным и высоким потенциалом утраты самостоятельности.

До проведения этого исследования опасения, касающиеся потери самостоятельности из-за использования ИИ-ассистентов, были скорее теоретическими. Не хватало данных о том, как это происходит на практике. Работа учёных из Корнелльского университета — первый шаг в этом направлении. Создатели Claude отмечают связь с проблемой «поддакивания» пользователю. Его уровень снижается в новых моделях, но полностью проблема не устранена. Авторы анализа утверждают, что технических ограничений недостаточно. Защитные механизмы чаще реагируют на отдельные сообщения, а не на устойчивые модели поведения.

Потенциал утраты самостоятельности в исследовании обусловлен также динамикой взаимодействия с Claude. Пользователи проецировали авторитет, делегировали рассуждения, принимали ответы без самостоятельного анализа.

В безопасности работы с ИИ-ассистентами важна роль человека — помощь в распознавании моментов, когда люди начинают передавать нейросетям мыслительный процесс. Также имеет значение понимание факторов, которые повышают риски такого взаимодействия.

Учёные из Корнелльского университета уверены: паттерны из исследования касаются не только нейросети Claude. Они могут возникать при использовании любых ИИ-ассистентов с широкой аудиторией. Особого внимания требует разрыв между тем, как пользователи воспринимают взаимодействие с нейросетью в моменте, и тем, как оценивают их постфактум. Сокращение этого разрыва — задача исследователей, разработчиков ИИ и самих пользователей.

От редакции

Исследование не призывает отказаться от ИИ-ассистентов. Сегодня школьники всё чаще используют нейросети для учёбы: чтобы разобраться в теме, структурировать материал, подготовиться к экзамену. Это удобный инструмент — но только при условии, что он не подменяет собственное мышление.

Проще говоря, важно учиться работать с ИИ осознанно: понимать ограничения, задавать уточняющие вопросы, проверять ответы и использовать нейросеть как помощника, а не как источник окончательных решений. Научиться безопасно и с толком использовать ИИ-ассистентов можно самостоятельно. А можно вместе с теми, кто это уже умеет, например на курсе «Нейросети для учёбы и жизни».

13 февраля 2026

13 февраля 2026  416

416

Статья

Статья